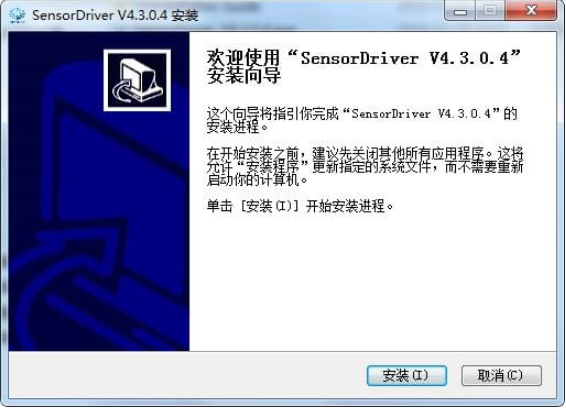

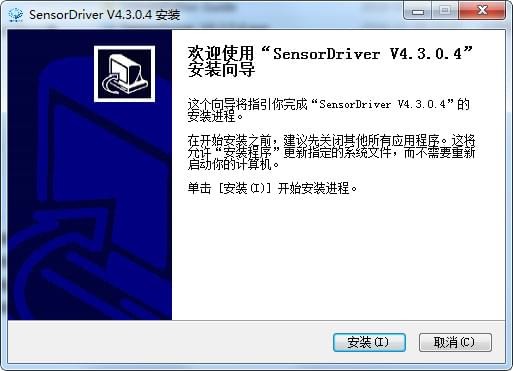

sensordriverözŽ±Ņ^“īäėīŻśIĄ─özŽ±Ņ^╠Ä└Ē▄ø╝■Ż¼─▄ē“ĮŌøQ╚š│Ż▓╗═¼Ą─özŽ±Ņ^“īäėŻ¼ā╚ĖĮ▓┘ū„╩╣ė├šf├„Ż¼ĘŪ│ŻĄ─║åå╬Ūę║├ė├Ż¼ī”┤╦ėą╦∙┼d╚żĄ─įÆŻ¼─ŪŠ═┐ņüĒ▀@└’Ž┬▌d░╔ŻĪ

sensordriver├Ō┘M░µ║åĮķ

SensorDriver╩Ūę╗┐ŅĘŪ│Ż▓╗ÕeĄ─özŽ±Ņ^“īäė▄ø╝■Ż¼╩╣ė├▀@┐Ņ▄ø╝■─▄ē“┐ņ╦┘ĮŌøQözŽ±Ņ^¤oĘ©š²│Ż╣żū„ęį╝░¤oĘ©ūRäeĄ─å¢Ņ}Ż¼║¼ėąManual Installation Guide╩╣ė├╩ųāįŻ¼╝░orbbec-sensor-driver-4.3.0.4-whql░µ“īäėŻ¼ėąąĶꬥ─┌s┐ņŽ┬▌d░╔ŻĪ

HALĮė┐┌īė

į┌Ąūīė“īäėųą├„├„š²┤_╝ė▌d┴╦gsensor,msensor,psensorĄ╚“īäė┴╦Ż¼▓óø]ėą│÷¼FI2CÕeš`Ż©é„ĖąŲ„Č╝╩ŪI2CŲ„╝■Ż®Ż¼Ą½╩Ūį┌ŽĄĮyųąåóäė

Ģrhwsen_open()ĢrŻ¼īóŽĄĮy╠Ē╝ėĄ─é„ĖąŲ„▒ķÜvĢrŻ¼ł¾│÷sensor(?)ø]ėą╠Ē╝ė│╔╣”Ż¼╗“š▀į┌╔Žīėæ¬ė├ųąåóäė▀@ą®é„ĖąŲ„ĢrŻ¼▓ó▓╗─▄│╔╣”

┤“ķ_ĪŻ└²╚ńųĖ─Žßś▓╗─▄ė├(msensor)Ż¼ŽĄĮyįOų├ųą▓╗─▄ÖMžQŲ┴(gsensor)Ż¼┤“ļŖįÆĄ─Ģr║“ļŖįÆ┐┐Į³ĢrŲ┴─╗▓╗£ńŻ©psensorŻ®ĪŻ

│÷¼Fęį╔ŽŽĄĮy“īäė╝ė▌d│╔╣”Ż¼Ą½╩ŪŽĄĮy╔Žīė╩╝ĮKČ╝▓╗─▄ē“åóäėé„ĖąŲ„║═åóäėī”æ¬Ą─é„ĖąŲ„Ą─Ę■䚯¼ę╗░Ńå¢Ņ}Š═╩Ū│÷į┌ųąķgīėĪŻ

į┌MTKųąĄ─mediatek/custom/($ĒŚ─┐├¹)/hal/sensors/sensor/hwmsen_custom.hųąø]ėą╠Ē╝ėĒææ¬Ą─é„ĖąŲ„ĪŻ

ī¦ų┬╔Žīėį┌╝ė▌dé„ĖąŲ„─ŻēKĄ─Ģr║“(sensor_module_init())Ż¼▓╗─▄šęĄĮī”æ¬Ą─é„ĖąŲ„▀Mąą╠Ē╝ėĪŻ╦∙ęįŠ═▒Ē¼F│÷╝ė▌dé„ĖąŲ„“īäėš²│ŻŻ¼

Ą½╩Ū╔Žīė▓╗─▄åóė├é„ĖąŲ„Ą─¼FŽ¾ĪŻ

mediatek/custom/($ĒŚ─┐├¹)/hal/sensors/sensor/hwmsen_custom.h

SensorBase┤·┤a

AndroidĄ─ė▓╝■│ķŽ¾īė,║åå╬üĒšf,Š═╩Ūī”Linuxā╚║╦“īäė│╠ą“Ą─ĘŌčb,Ž“╔Ž╠ß╣®Įė┐┌,Ų┴▒╬Ą═īėĄ─īŹ¼F╝Ü╣ØĪŻę▓Š═╩Ūšf,░čī”ė▓╝■Ą─ų¦│ųĘų│╔┴╦ā╔īė,ę╗īėĘ┼į┌ė├æ¶┐šķgŻ©User SpaceŻ®,ę╗īėĘ┼į┌ā╚║╦┐šķgŻ©Kernel SpaceŻ®,Ųõųą,ė▓╝■│ķŽ¾īė▀\ąąį┌ė├æ¶┐šķg,Č°Linuxā╚║╦“īäė│╠ą“▀\ąąį┌ā╚║╦┐šķgĪŻ×ķ╩▓├┤ę¬▀@śė░▓┼┼─žŻ┐░čė▓╝■│ķŽ¾īė║═ā╚║╦“īäėš¹║Žį┌ę╗ŲĘ┼į┌ā╚║╦┐šķg▓╗┐╔ąąå߯┐Å─╝╝ągīŹ¼FĄ─ĮŪČ╚üĒ┐┤,╩Ū┐╔ęįĄ─,╚╗Č°Å─╔╠śIĄ─ĮŪČ╚üĒ┐┤,░čī”ė▓╝■Ą─ų¦│ų▀ē▌ŗČ╝Ę┼į┌ā╚║╦┐šķg,┐╔─▄Ģ■ōp║”ÅS╝ęĄ─└¹ęµĪŻų¬Ą└,Linux ā╚║╦į┤┤·┤a░µÖÓū±čŁGNU License,Č°Androidį┤┤·┤a░µÖÓū±čŁApache License,Ū░š▀į┌░l▓╝«aŲĘĢr,▒žĒÜ╣½▓╝į┤┤·┤a,Č°║¾š▀¤oĒÜ░l▓╝į┤┤·┤aĪŻ╚ń╣¹░čī”ė▓╝■ų¦│ųĄ─╦∙ėą┤·┤aČ╝Ę┼į┌Linux“īäėīė,─ŪŠ═ęŌ╬Čų°░l▓╝Ģrę¬╣½ķ_“īäė│╠ą“Ą─į┤┤·┤a,Č°╣½ķ_į┤┤·┤aŠ═ęŌ╬Čų°░čė▓╝■Ą─ŽÓĻPģóöĄ║═īŹ¼FČ╝╣½ķ_┴╦,į┌╩ųÖC╩ął÷ĖéĀÄ╝ż┴ęĄ─Į±╠ņ,▀@ī”ÅS╝ęüĒšf,ōp║”╩ŪĘŪ│Ż┤¾Ą─ĪŻę“┤╦,Android▓┼Ģ■ŽļĄĮ░čī”ė▓╝■Ą─ų¦│ųĘų│╔ė▓╝■│ķŽ¾īė║═ā╚║╦“īäėīė,ā╚║╦“īäėīėų╗╠ß╣®║åå╬Ą─įLå¢ė▓╝■▀ē▌ŗ,└²╚ńūxīæė▓╝■╝─┤µŲ„Ą─═©Ą└,ų┴ė┌Å─ė▓╝■ųąūxĄĮ┴╦╩▓├┤ųĄ╗“š▀īæ┴╦╩▓├┤ųĄĄĮė▓╝■ųąĄ─▀ē▌ŗ,Č╝Ę┼į┌ė▓╝■│ķŽ¾īėųą╚ź┴╦,▀@śėŠ═┐╔ęį░č╔╠śI├ž├▄ļ[▓žŲüĒ┴╦ĪŻę▓š²╩Ūė╔ė┌▀@éĆĘųīėĄ─įŁę“,Android▒╗╠▀│÷┴╦Linuxā╚║╦ų„ŠĆ┤·┤aśõųąĪŻ┤¾╝ęŽļŽļ,AndroidĘ┼į┌ā╚║╦┐šķgĄ─“īäė│╠ą“ī”ė▓╝■Ą─ų¦│ų╩Ū▓╗═Ļš¹Ą─,░čLinuxā╚║╦ęŲų▓ĄĮäeĄ─ÖCŲ„╔Ž╚źĢr,ė╔ė┌╚▒Ę”ė▓╝■│ķŽ¾īėĄ─ų¦│ų,ė▓╝■Š══Ļ╚½▓╗─▄ė├┴╦,▀@ę▓╩Ū×ķ╩▓├┤šfAndroid╩Ūķ_Ę┼ŽĄĮyČ°▓╗╩Ūķ_į┤ŽĄĮyĄ─įŁę“ĪŻ═©ŲĮ┼_sensor╝▄śŗHALīėę▓▒žĒÜØMūŃAndroidŽĄĮyHALīėęÄĘČ,ąĶę¬ī”╦³Ą─╔Žę╗īėFrameworkīė╠ß╣®ś╦£╩Ą─Įė┐┌,Č°▀@ą®Įė┐┌Ą─Š▀¾wīŹ¼Fę“ŲĮ┼_Č°«É;Ė▀═©ŲĮ┼_Ą─š¹éĆSensor HALīė┤·┤aĘų×ķ┴╦╚²īė,Ęųäe╩ŪHALĮė┐┌īėŻ©ś╦£╩Ą─AndroidĮė┐┌Ż®,Sensorųąķgīė,║═Sensor“īäėīė;Sensor“īäėīėŻ║╠ß╣®┴╦├┐éĆsensorįLå¢Ąūīėsensor“īäėĄ─Įė┐┌;SensorųąķgīėŻ║Ų│ą╔ŽåóŽ┬Ą─ū„ė├,ī”Ž┬žōž¤ĮM┐Ś║═╣▄└Ē▀@ą®sensor,▓ó═©▀^╬’└ĒsensoräōĮ©ę╗ą®ėąīŹļH╣”─▄Ą─╠ōöMsensor,╚ńųĖ─Žßśsensorät╩Ūė╔ųž┴”é„ĖąŲ„║═Ąž┤┼é„ĖąŲ„ā╔ŅwīŹļHĄ─sensor ╠ōöM│÷üĒĄ─,▀@ą®╠ōöMĄ─sensor ┼cīŹļHsensorī”frameworkīėČ°čįČ╝╩Ūę╗śė,frameworkīėĢ■░č▀@ą®sensorČ╝«ö│╔¬Ü┴óĄ─sensor;ī”╔Ž╠ß╣®HALĮė┐┌īėįLå¢┐žųŲĖ„éĆsensorĄ─Įė┐┌;

- PC╣┘ĘĮ░µ

- ░▓ū┐╣┘ĘĮ╩ųÖC░µ

- IOS╣┘ĘĮ╩ųÖC░µ

║ŻļÓ▀h│╠┐žųŲļŖ─X░µ3.2 š²╩Į░µ

║ŻļÓ▀h│╠┐žųŲļŖ─X░µ3.2 š²╩Į░µ

v380▒O┐ž▄ø╝■ļŖ─X░µ2.0.4 ╣┘ĘĮPC░µ

v380▒O┐ž▄ø╝■ļŖ─X░µ2.0.4 ╣┘ĘĮPC░µ

anyviewerļŖ─XpcČ╦3.3.0 ╣┘ĘĮ░µ

anyviewerļŖ─XpcČ╦3.3.0 ╣┘ĘĮ░µ

wangooe▀h│╠┐žųŲ▄ø╝■v4.1.3 ūŅą┬░µ

wangooe▀h│╠┐žųŲ▄ø╝■v4.1.3 ūŅą┬░µ

NxShellųą╬─░µ1.6.2 ├Ō┘M░µ

NxShellųą╬─░µ1.6.2 ├Ō┘M░µ

├ļ³c▀h│╠┐žųŲ▄ø╝■1.3.4.0 ╣┘ĘĮūŅą┬░µ

├ļ³c▀h│╠┐žųŲ▄ø╝■1.3.4.0 ╣┘ĘĮūŅą┬░µ

ev▀h│╠ģfų·ļŖ─X░µ0.2.2 ╣┘ĘĮ░µ

ev▀h│╠ģfų·ļŖ─X░µ0.2.2 ╣┘ĘĮ░µ

77ļŖ─Xų·╩ų┐═æ¶Č╦1.0.4 pc░µ

77ļŖ─Xų·╩ų┐═æ¶Č╦1.0.4 pc░µ

▀B▀B┐ž▀h│╠┐žųŲ1.0.0.26 ┐═æ¶Č╦

▀B▀B┐ž▀h│╠┐žųŲ1.0.0.26 ┐═æ¶Č╦

vms▒O┐ž╣▄└ĒŽĄĮy(Video Monitor System)1.0.3.1 ├Ō┘M░µ

vms▒O┐ž╣▄└ĒŽĄĮy(Video Monitor System)1.0.3.1 ├Ō┘M░µ

Video Monitor Client(ęĢŅl▒O┐ž▄ø╝■)CMS3.0 ├Ō┘M░µ

Video Monitor Client(ęĢŅl▒O┐ž▄ø╝■)CMS3.0 ├Ō┘M░µ

įŲČõ╩žūoļŖ─X░µ1.0.0.820 ▒╗┐žČ╦

įŲČõ╩žūoļŖ─X░µ1.0.0.820 ▒╗┐žČ╦

╠ņęĒįŲč█▒O┐ž▄ø╝■2.4.0 ╣┘ĘĮpc░µ

╠ņęĒįŲč█▒O┐ž▄ø╝■2.4.0 ╣┘ĘĮpc░µ

Free ControlĪŠė├ļŖ─X┐žųŲ╩ųÖCĪ┐1.3.0ūŅą┬░µ

Free ControlĪŠė├ļŖ─X┐žųŲ╩ųÖCĪ┐1.3.0ūŅą┬░µ

ęūęĢįŲļŖ─X┐═æ¶Č╦3.0.5.6 ╣┘ĘĮPC░µ

ęūęĢįŲļŖ─X┐═æ¶Č╦3.0.5.6 ╣┘ĘĮPC░µ

┤¾╚AÕ½ŅŻ┐═æ¶Č╦1.0 ╣┘ĘĮpc░µ

┤¾╚AÕ½ŅŻ┐═æ¶Č╦1.0 ╣┘ĘĮpc░µ

rdviewer▀h│╠╣▄└Ē▄ø╝■1.6.0 ŠG╔½░µ

rdviewer▀h│╠╣▄└Ē▄ø╝■1.6.0 ŠG╔½░µ

ÄøŪ¼╔±─┐ļŖ─X▒O┐žŽĄĮy1.3 ├Ō┘M░µ

ÄøŪ¼╔±─┐ļŖ─X▒O┐žŽĄĮy1.3 ├Ō┘M░µ

trustviewer▀h│╠╣żŠ▀2.7.1├Ō┘M░µ

trustviewer▀h│╠╣żŠ▀2.7.1├Ō┘M░µ

╝tįŲŲ┴─╗ĘųŽĒ▄ø╝■4.3.21.2 ūŅą┬░µ

╝tįŲŲ┴─╗ĘųŽĒ▄ø╝■4.3.21.2 ūŅą┬░µ

ŽŻ╠®ACęĢŅl▒O┐žļŖ─XČ╦1.0.1.3╣┘ĘĮ░µ

ŽŻ╠®ACęĢŅl▒O┐žļŖ─XČ╦1.0.1.3╣┘ĘĮ░µ

todesk▀h│╠┐žųŲ▄ø╝■4.6.23 ╣┘ĘĮ░µ

todesk▀h│╠┐žųŲ▄ø╝■4.6.23 ╣┘ĘĮ░µ

Ž“╚š┐¹▀h│╠┐žųŲ▄ø╝■13.1.0.48900 ╣┘ĘĮ░µ

Ž“╚š┐¹▀h│╠┐žųŲ▄ø╝■13.1.0.48900 ╣┘ĘĮ░µ

AnyDesk(▀h│╠ū└├µ▀BĮė▄ø╝■)7.1.8 ųą╬─░µ

AnyDesk(▀h│╠ū└├µ▀BĮė▄ø╝■)7.1.8 ųą╬─░µ

TeamViewer▀h│╠┐žųŲ▄ø╝■15.17.6 ŠG╔½░µ

TeamViewer▀h│╠┐žųŲ▄ø╝■15.17.6 ŠG╔½░µ

┤¾│■įŲ┐žļŖ─X┐═æ¶Č╦1.0.7 ╣┘ĘĮ░µ

┤¾│■įŲ┐žļŖ─X┐═æ¶Č╦1.0.7 ╣┘ĘĮ░µ

ŠWĮj╚╦(Netman)Ųņ┼×░µ2.501 ╣┘ĘĮ░µ

ŠWĮj╚╦(Netman)Ųņ┼×░µ2.501 ╣┘ĘĮ░µ

·Śč█ųą┐ž2.0.10.240020╣┘ĘĮ░µ

·Śč█ųą┐ž2.0.10.240020╣┘ĘĮ░µ

¤oė░─_▀h│╠ū└├µ1.0 ūŅą┬░µ

¤oė░─_▀h│╠ū└├µ1.0 ūŅą┬░µ

śĘ│╚PC┐═æ¶Č╦5.5.1.0 ╣┘ŠWūŅą┬┐═æ¶Č╦

śĘ│╚PC┐═æ¶Č╦5.5.1.0 ╣┘ŠWūŅą┬┐═æ¶Č╦

Mstsc┼·┴┐╣▄└Ē╣żŠ▀1.0ŠG╔½░µ

Mstsc┼·┴┐╣▄└Ē╣żŠ▀1.0ŠG╔½░µ

╩ž═¹š▀ļŖ─X▒O┐ž▄ø╝■2020├Ō┘M░µ

╩ž═¹š▀ļŖ─X▒O┐ž▄ø╝■2020├Ō┘M░µ

║¾ķT▒O┐žų·╩ų1.0.7ūŅą┬░µ

║¾ķT▒O┐žų·╩ų1.0.7ūŅą┬░µ

░ĪčĮ▀h┐ž╣▄└ĒČ╦░▓čb░µ3.0 ╣┘ĘĮ░µ

░ĪčĮ▀h┐ž╣▄└ĒČ╦░▓čb░µ3.0 ╣┘ĘĮ░µ

║Ż┐Ą═■ęĢŠWĮjęĢŅl▒O┐ž▄ø╝■V2.04.02.02 ╣┘ĘĮ░▓čb░µ(║¼╩╣ė├šf├„)

║Ż┐Ą═■ęĢŠWĮjęĢŅl▒O┐ž▄ø╝■V2.04.02.02 ╣┘ĘĮ░▓čb░µ(║¼╩╣ė├šf├„)

║Ż┐Ą═■ęĢivms 4200(ivms 4200 ┐═æ¶Č╦)2.4.0

║Ż┐Ą═■ęĢivms 4200(ivms 4200 ┐═æ¶Č╦)2.4.0 360ųŪ─▄özŽ±ÖCļŖ─X┐═æ¶Č╦5.6.8.0 ╣┘ĘĮpc░µ

360ųŪ─▄özŽ±ÖCļŖ─X┐═æ¶Č╦5.6.8.0 ╣┘ĘĮpc░µ ┤¾╚Apss▒O┐ž▄ø╝■(┤¾╚Apss┐═æ¶Č╦)4.5ųą╬─░▓čb

┤¾╚Apss▒O┐ž▄ø╝■(┤¾╚Apss┐═æ¶Č╦)4.5ųą╬─░▓čb ┤¾╗ę└Ū▀h│╠╣▄└Ē1.1 ŠG╔½├ŌÜó░µ

┤¾╗ę└Ū▀h│╠╣▄└Ē1.1 ŠG╔½├ŌÜó░µ IPC BatchTool(ųą┐ž8ŽĄ┴ąIP╦č╦„╣żŠ▀)3.1.1

IPC BatchTool(ųą┐ž8ŽĄ┴ąIP╦č╦„╣żŠ▀)3.1.1  realvnc(VNC▀h│╠┐žųŲ▄ø╝■)5.3.2 ųą╬─ŲŲĮŌ░µ

realvnc(VNC▀h│╠┐žųŲ▄ø╝■)5.3.2 ųą╬─ŲŲĮŌ░µ